NVIDIA 宣布与软银公司开展一系列合作,旨在加速日本的主权 AI 计划,进一步巩固其全球技术领先地位,同时为全球电信提供商释放数十亿美元的 AI 收入机会。

NVIDIA 创始人兼首席执行官黄仁勋在日本 AI 峰会上发表主题演讲时宣布,软银正在使用 NVIDIA Blackwell 平台构建日本最强大的 AI 超级计算机,并计划将 NVIDIA Grace Blackwell 平台用于其下一台超级计算机。

此外,NVIDIA 还透露,软银使用 NVIDIA AI Aerial 加速计算平台,已成功试行全球首个 AI 和 5G 电信相结合的网络,这是计算领域的突破,为电信运营商开辟了价值数十亿美元的 AI 收入流。

NVIDIA 和软银还宣布,软银旨在使用 NVIDIA AI Enterprise 软件创建一个 AI 市场,以满足对本地安全 AI 计算的需求。这项支持 AI 训练和边缘 AI 推理的新服务使软银成为日本的 AI 网格,为日本各行业、消费者和企业的 AI 服务的创建、分发和使用提供新的商机。

“日本在开拓具有全球影响力的技术创新方面有着悠久的历史,”黄仁勋说。“随着软银对 NVIDIA 全栈 AI、Omniverse 和 5G AI-RAN 平台的重大投资,日本正在跃入 AI 工业革命,成为全球领导者,推动电信、运输、机器人和医疗保健行业进入增长新时代,这将在 AI 时代极大地造福人类。”

“全球国家和地区正在加速采用人工智能促进社会和经济增长,社会正在发生重大变革,”软银总裁兼首席执行官 Junichi Miyakawa 说。“通过与 NVIDIA 的长期合作,软银正在引领这一转型。凭借我们极其强大的 AI 基础设施和我们为 AI 重塑 5G 网络的新型分布式 AI-RAN 解决方案'AITRAS',我们将加速全国和全球的创新。

软银率先获得 Blackwell,Grace Blackwell 的计划

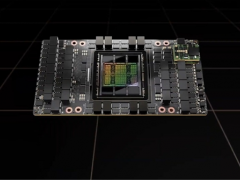

软银计划接收世界上第一台 NVIDIA DGX B200 系统,该系统将作为其新型 NVIDIA DGX SuperPOD 超级计算机的构建块。该公司计划将其由 Blackwell 提供支持的 DGX SuperPOD 用于自己的生成式 AI 开发和 AI 相关业务,以及日本各地的大学、研究机构和企业的业务。

完成后,软银的 DGX SuperPOD 有望成为日本迄今为止性能最高的产品。它采用 NVIDIA AI Enterprise 软件和 NVIDIA Quantum-2 InfiniBand 网络,也是开发大型语言模型的理想选择。

除了 DGX SuperPOD 之外,软银还计划构建另一台 NVIDIA 加速的超级计算机,以运行计算密集型工作负载。该超级计算机的初步计划基于 NVIDIA Grace Blackwell 平台设计,该平台采用 NVIDIA GB200 NVL72 多节点、液冷、机架级系统,将 NVIDIA Blackwell GPU 与基于 Arm 的节能 NVIDIA Grace CPU 相结合。

AI-RAN 达到新的里程碑

通过与 NVIDIA 密切合作,软银实现了一个技术里程碑,即开发一种可以同时运行 AI 和 5G 工作负载的新型电信网络,业界称为人工智能无线接入网络 (AI-RAN)。这种新型基础设施得到了电信行业的广泛生态系统支持,因为它使运营商能够将其基站从成本中心转变为 AI 创收资产。

通过在神奈川县进行的户外试验,软银证明其 NVIDIA 加速的 AI-RAN 解决方案已经实现了运营商级 5G 性能,并且能够在利用网络的过剩容量并发运行 AI 推理工作负载的同时实现这一目标。

传统的电信网络旨在处理峰值负载,平均而言,仅使用了该容量的三分之一。借助 AI-RAN 提供的通用计算能力,预计电信公司现在有机会将剩余的三分之二容量货币化 AI 推理服务。

NVIDIA 和软银估计,电信运营商每投资 1 美元的资本支出用于新的 AI-RAN 基础设施,即可赚取大约 5 美元的 AI 推理收入。考虑到其运营支出和资本支出成本,软银估计,其添加到基础设施中的每台 AI-RAN 服务器可以实现高达 219% 的回报。

在 AI-RAN 上运行真实世界的推理

在试验中,软银使用 NVIDIA AI Enterprise 构建了现实世界的 AI 推理应用程序,包括自动驾驶汽车远程支持、机器人控制和边缘多模态检索自动生成。所有推理工作负载都能够在 SoftBank 的 AI-RAN 网络上以最佳方式运行。

软银的完全软件定义 5G 无线电堆栈针对 NVIDIA 的 AI 计算平台进行了优化,包括软银基于 NVIDIA Aerial CUDA 加速 RAN 库增强的 L1 软件。软银计划将 NVIDIA Aerial RAN Computer-1 系统整合到其未来的解决方案中,该系统估计其功耗比传统 5G 网络基础设施低 40%。

为软银 AI-RAN 解决方案的试用做出贡献的 NVIDIA 和软银合作伙伴包括 Fujitsu 和 Red Hat。

供需匹配

由于 AI-RAN 解决方案需要根据需求和供应动态地增加或减少计算,而不会影响运营商级性能,因此软银旨在通过使用 NVIDIA AI Enterprise 无服务器应用程序编程接口及其内部开发的编排器来构建一个连接 AI 技术供需的生态系统。这使 SoftBank 能够在计算资源可用时将外部 AI 推理作业分派给 AI-RAN 服务器,以提供本地化、低延迟、安全的推理服务。

“从单一用途 AI-RAN 网络转变为多用途 AI-RAN 网络可能意味着每投入一美元资本支出的收入就会增加 5 倍,”NVIDIA 电信高级副总裁 Ronnie Vasishta 表示。“软银的现场试验标志着向 AI-RAN 商业化迈出了一大步,验证了技术的可行性、性能和经济性。”

“软银的'AITRAS'是通过与 NVIDIA 五年合作开发的首个 AI-RAN 解决方案。它通过软银开发的编排器集成和协调 AI 和 RAN 工作负载,通过在单个 NVIDIA 加速的 GPU 服务器上运行密集单元来提高通信效率,“软银副总裁兼先进技术研究所所长 Ryuji Wakikawa 说。“我们相信,这种人工智能驱动的创新 AITRAS 将为电信领域的新商业模式铺平道路,成为移动运营商转型的关键因素。”

在此处详细了解适用于 AI-RAN 的 NVIDIA 解决方案。